ปัญหาและความสำคัญ ในยุคปัจจุบันที่เทคโนโลยีปัญญาประดิษฐ์ (AI) เข้ามามีบทบาทสำคัญ แต่ข้อจำกัดใหญ่คือโมเดล AI ส่วนใหญ่มักมีขนาดใหญ่และกินทรัพยากรสูง ทำให้ยากต่อการนำไปใช้งานบนฮาร์ดแวร์ขนาดเล็กหรือไมโครคอนโทรลเลอร์ที่มีหน่วยความจำ (RAM/Flash) จำกัด แม้เทคนิคเดิมอย่าง Transfer Learning จะช่วยได้ แต่บ่อยครั้งมักได้โมเดลที่ "เกินความจำเป็น" (Overkill) และสิ้นเปลืองพลังงาน

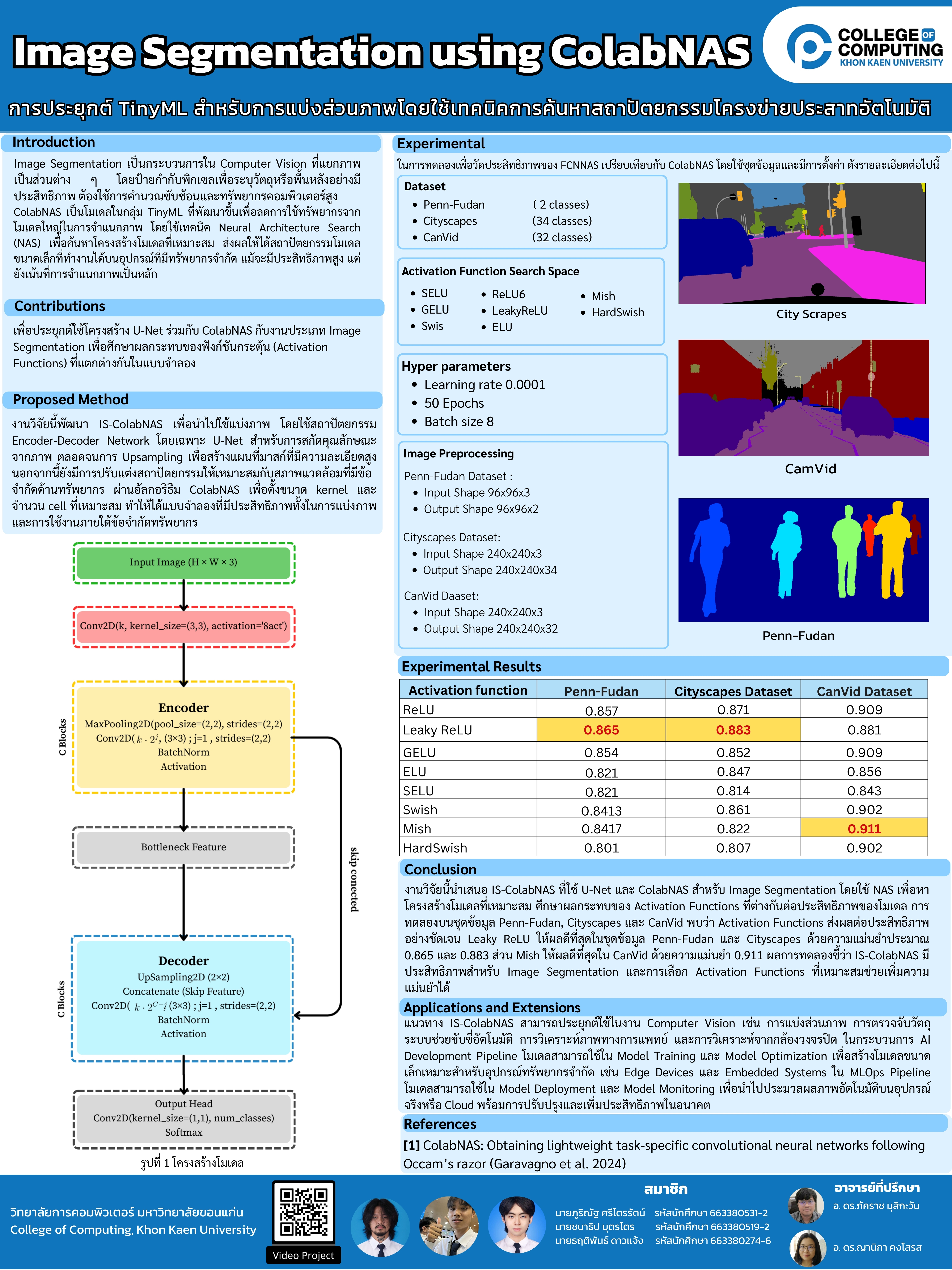

วิธีการดำเนินงาน งานวิจัยนี้จึงนำเสนอ “ColabNAS” เทคนิคการค้นหาสถาปัตยกรรมโครงข่ายประสาทเทียมแบบใหม่ที่เน้นความประหยัดและประสิทธิภาพสูง โดยใช้กลยุทธ์การค้นหาแบบ Derivative-free ตามหลักการ Occam's razor คือการเริ่มจากโครงสร้างที่เรียบง่ายที่สุด แล้วค่อยๆ เพิ่มความลึก (เซลล์) และความกว้าง (ฟิลเตอร์) ตามความจำเป็นของงานเท่านั้น จุดเด่นคือระบบจะคำนวณโดยคำนึงถึงข้อจำกัดทางฮาร์ดแวร์จริง เช่น ขนาด RAM และความเร็วในการประมวลผลเป็นตัวตั้งเสมอ

ผลลัพธ์และความสำเร็จ ผลการทดสอบพบว่า ColabNAS สามารถสร้างโมเดลที่มีขนาด "เล็กกว่ามหาศาล" เมื่อเทียบกับวิธีทั่วไป โดยในการทดสอบมาตรฐาน (Visual Wake Words) ColabNAS สามารถทำความแม่นยำได้สูงถึง 77.6% ชนะโมเดลระดับโลกอย่าง MicroNets ขณะที่ใช้ RAM น้อยกว่าเกินครึ่ง และใช้พื้นที่จัดเก็บน้อยกว่าถึง 10 เท่า ที่สำคัญคือ ColabNAS มีต้นทุนการพัฒนาที่ต่ำมาก โดยใช้เวลาค้นหาสถาปัตยกรรมเพียง 3.1 ชั่วโมง บนทรัพยากรฟรีอย่าง Google Colab ซึ่งเร็วกว่าเทคนิคระดับสากลอื่นๆ ที่ต้องใช้เวลาค้นหานานถึง 300 ชั่วโมง

บทสรุปและประโยชน์ ความสำเร็จของ ColabNAS คือการพิสูจน์ว่าเราสามารถสร้าง AI ที่ชาญฉลาดและแม่นยำได้ภายใต้ทรัพยากรที่จำกัด นวัตกรรมนี้จะเป็นกุญแจสำคัญในการเปลี่ยนให้อุปกรณ์ IoT และบอร์ดควบคุมขนาดเล็กทั่วไป สามารถทำงานด้วยปัญญาประดิษฐ์ขั้นสูงได้อย่างมีประสิทธิภาพ เข้าถึงง่าย และยั่งยืน